Представьте себе программу или робота, который не просто выполняет ваши команды, а сам понимает, что нужно сделать для достижения цели, и действует автономно. AI-агент — это автономная система, способная воспринимать окружающий мир, принимать решения и выполнять задачи без постоянного контроля со стороны человека.

Почему об этом все говорят именно сейчас? Технологии ИИ развиваются с бешеной скоростью. Мы уже привыкли к чат-ботам и рекомендательным системам, AI-агенты — это следующий шаг. Они обещают еще большую автоматизацию, персонализацию и эффективность. Бизнес видит в них способ оптимизировать процессы, ученые — инструмент для сложных исследований, а мы с вами — потенциальных помощников в повседневной жизни.

В этой статье заглянем «под капот» AI-агентов. Мы разберемся:

- Что это такое на самом деле?

- Как они «думают» и работают?

- Где и зачем они уже применяются (и будут применяться)?

Что такое AI-агент

Давайте разберемся в основах и дадим четкое определение.

AI-агент (или интеллектуальный агент) — это, по сути, программная (а иногда и физическая, как робот) сущность, которая:

- Воспринимает свое окружение (через сенсоры, данные, API, текст и т. д.).

- Принимает решения на основе этого восприятия и своих целей.

- Действует в этом окружении, чтобы достичь поставленных целей.

В чем ключевое отличие от «классических» ИИ-систем

Многие ИИ-модели, с которыми вы могли сталкиваться (например, модель для распознавания котиков на фото или для перевода текста), работают по принципу «вход -> обработка -> выход». Они реагируют на конкретный запрос. AI-агент же действует проактивно и автономно. Он не просто ждет команду, а сам инициирует действия, планирует шаги и адаптируется к изменениям для достижения долгосрочной цели. Представьте разницу между калькулятором (реагирует на нажатие кнопок) и роботом-пылесосом, который сам ездит по квартире, объезжает препятствия и возвращается на базу для зарядки (действует автономно для цели «чистый пол»).

Типы AI-агентов (упрощенно):

Чтобы лучше понять их разнообразие, выделим несколько основных типов и посмотрим на их логику работы:

- Простые реактивные агенты: реагируют только на текущее состояние среды по принципу «если…, то…». Памяти нет. Пример: термостат. Если температура < 20 °C, то включить обогрев.

- Агенты с памятью (Model-based): учитывают прошлый опыт, строят внутреннюю модель мира. Понимают, как действия меняют мир. Пример: робот-пылесос с картой квартиры. Помнит, где уже убирал.

- Целеполагающие агенты (Goal-based): знают свою цель и выбирают действия, которые к ней ведут. Используют планирование. Пример: GPS-навигатор. Цель — есть точка А и точка Б, планирует маршрут.

- Полезностные агенты (Utility-based): похожи на целеполагающих, но выбирают действия, максимизирующие «полезность» (счастье, эффективность, прибыль). Умеют сравнивать разные исходы. Пример: Торговый бот на бирже. Цель — не просто прибыль, а максимальная прибыль с учетом риска.

- Обучающиеся агенты: Способны улучшать свою производительность со временем, обучаясь на опыте. Общая схема обучения будет ниже, в разделе про работу агента.

В реальности агенты часто сочетают в себе черты нескольких типов.

Как работает AI-агент

Итак, как же эта «магия» происходит? В основе работы большинства AI-агентов лежит цикл взаимодействия со средой.

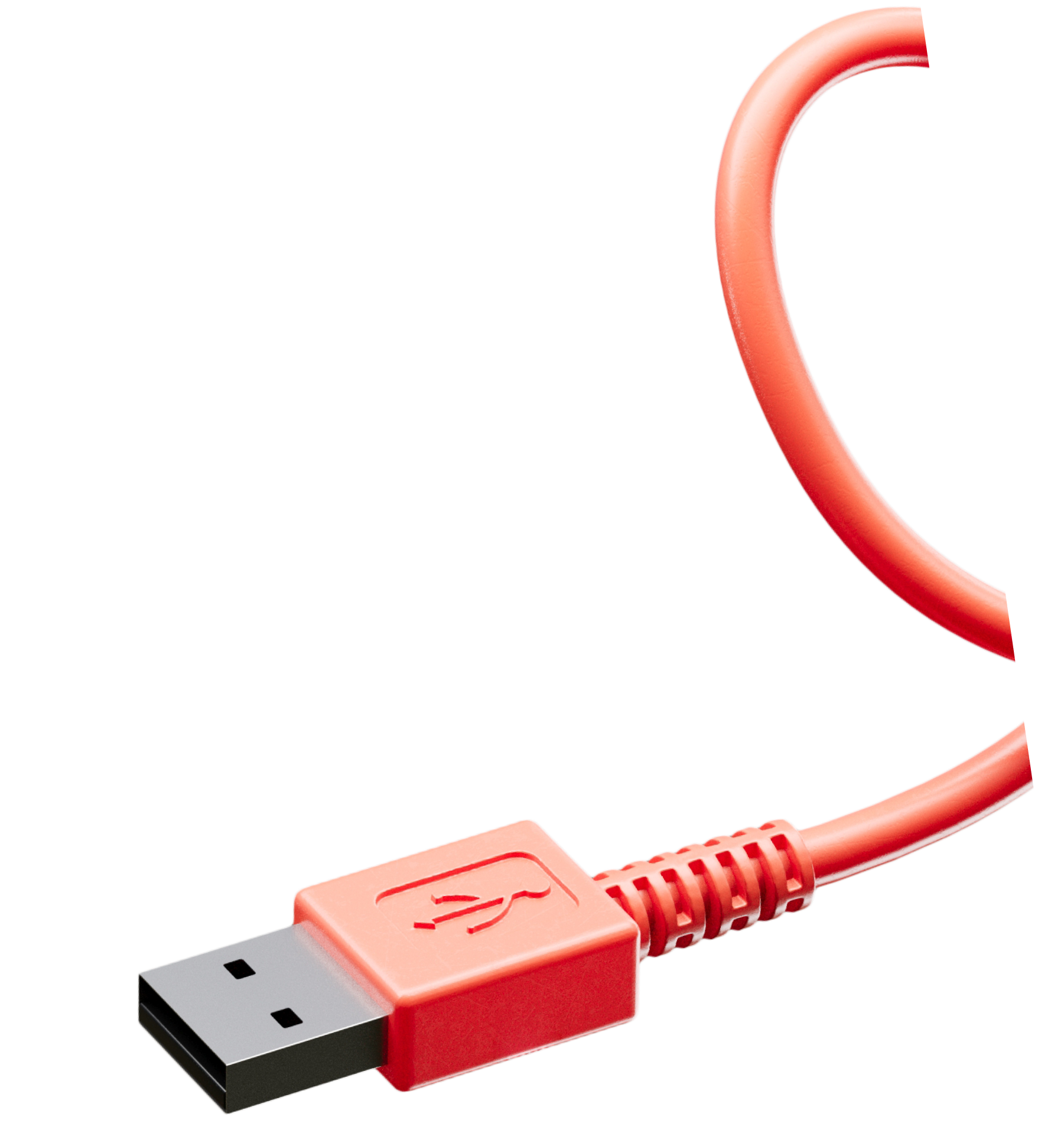

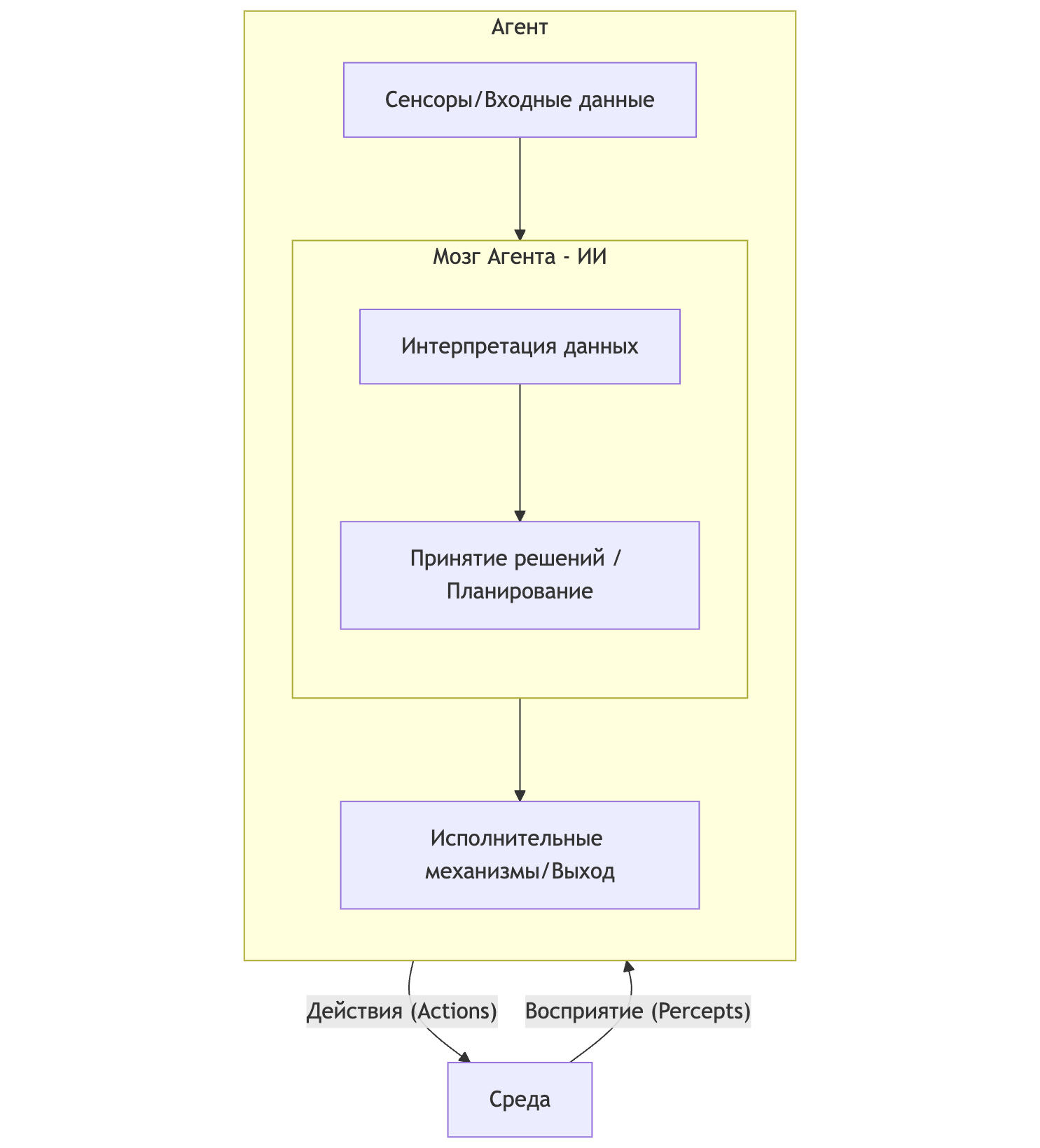

Основная архитектура (цикл «агент-среда»)

Это базовый цикл, который мы уже обсуждали:

- Восприятие окружающей среды: сбор данных (сенсоры, API, текст…).

- Интерпретация данных: анализ данных с помощью моделей ИИ (NLP, CV и т. д.).

- Принятие решений: выбор действия с помощью алгоритмов планирования, оптимизации.

- Выполнение действий: взаимодействие с миром (физическое или цифровое).

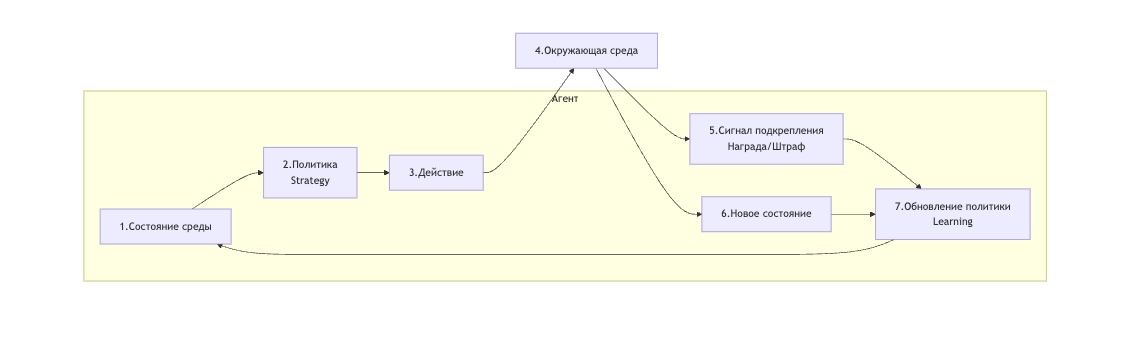

Роль обучения и обратной связи (Reinforcement Learning)

Как обучающиеся агенты становятся умнее? Через метод проб и ошибок с подкреплением:

Объяснение блоков:

- Состояние среды подается на вход Политике.

- Политика по текущему состоянию выдает Действие.

- Действие передается в Окружающую среду.

- Среда возвращает два результата:

- Новое состояние

- Сигнал подкрепления «Награда / Штраф»

- Сигнал подкрепления «Награда / Штраф» и Новое состояние идут в блок Обновление политики.

- Обновленная политика возвращается в блок Состояние среды, и цикл повторяется.

Этот цикл повторяется много раз, позволяя агенту постепенно «выучить» оптимальное поведение.

Для чего нужны AI-агенты

Теория — это хорошо, но где же реальная польза? AI-агенты находят применение во множестве областей.

- Автоматизация рутинных процессов:

- Поддержка клиентов (чат-боты) — представим умного чат-бота поддержки:

- Обработка документов — агенты для классификации, извлечения данных.

- Планирование — агенты для управления календарями, бронированиями.

- Управление сложными системами:

- Робототехника — автономные роботы на складах, марсоходы.

- Управление умными городами — оптимизация трафика, энергосетей.

- Автономный транспорт — беспилотные автомобили.

- Персонализация и рекомендации:

- Интеллектуальные ассистенты — Siri, Alexa, Google Assistant.

- Адаптивные системы обучения — персональные образовательные траектории.

- Персональные медицинские помощники — мониторинг здоровья.

- Принятие решений в реальном времени:

- Финансовые рынки — алготрейдинг.

- Системы предиктивной аналитики — предсказание отказов оборудования.

- Создание новых бизнес-моделей:

- Агенты-посредники — поиск лучших предложений.

- Агенты для генерации контента — написание текстов, создание изображений.

Примеры реальных AI-агентов

Чтобы сделать картину еще яснее, вот несколько конкретных примеров.

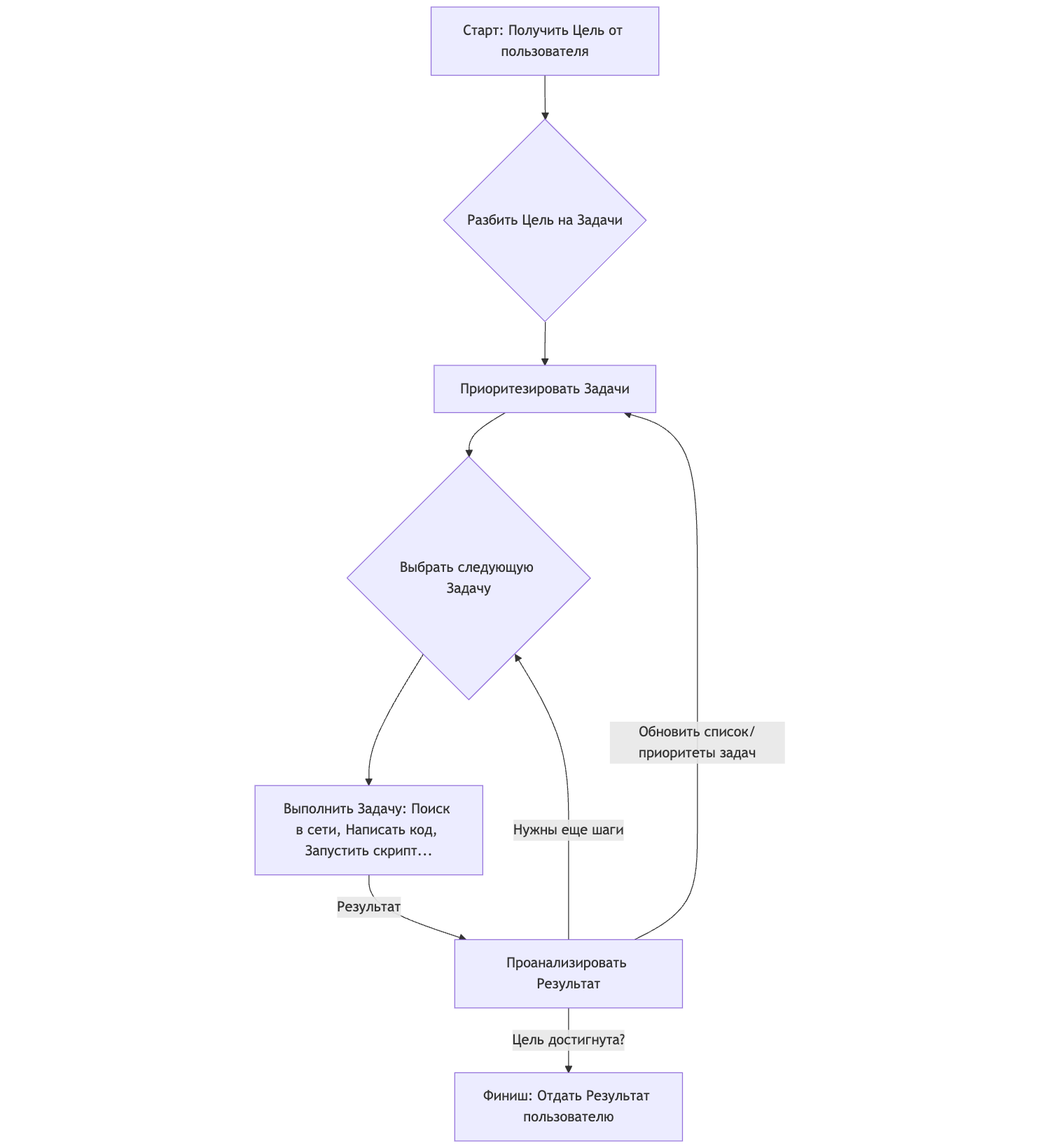

Экспериментальные агенты (шумевшие в 2023-м):

- AutoGPT / BabyAGI: Иллюстрация их упрощенного цикла работы. Эти агенты показывают потенциал автономного выполнения сложных многошаговых заданий.

- ReAct (Reasoning + Acting) Agents: подход, сочетающий рассуждение и действие, часто используется в современных фреймворках.

Примеры в повседневной жизни:

- Умные помощники (Siri, Alexa, Google Assistant): реагируют на голос, выполняют команды, управляют умным домом.

- Автономные роботы (Boston Dynamics): демонстрируют физическую автономию и адаптацию.

- Роботы-пылесосы: простой бытовой агент.

- Автопилоты (Tesla Autopilot / FSD): сложные агенты для управления автомобилем.

Возможные риски и вызовы

Как и любая мощная технология, AI-агенты несут не только возможности, но и риски:

- Проблемы автономности и контроля: как гарантировать, что агент не выйдет из-под контроля?

- Этические вопросы: кто несет ответственность за действия и ошибки агента?

- Надежность и интерпретируемость: почему агент принял именно такое решение? Особенно важно для критических систем.

- Безопасность: защита от взлома и злонамеренного использования.

Эти вызовы требуют серьезного внимания со стороны разработчиков, исследователей и общества.

Будущее AI-агентов

AI-агенты — логичный этап развития искусственного интеллекта. Это системы, способные самостоятельно воспринимать мир, принимать решения и действовать для достижения целей. Они уже автоматизируют рутину, управляют сложными системами и делают нашу жизнь удобнее. С помощью схем мы увидели, как различается логика их работы в зависимости от типа и как происходит обучение.

Ключ к их работе лежит в цикле «восприятие-интерпретация-решение-действие» и способности к обучению, особенно с помощью Reinforcement Learning.

Что дальше? Мы увидим:

- более умных и автономных агентов благодаря развитию ИИ-моделей;

- генеративных агентов, способных к творчеству и генерации нового;

- усиление сотрудничества человека и ИИ: агенты как партнеры;

- MCP-системы: читайте об этом в нашей отдельной статье тут.

Потенциал AI-агентов огромен, и они, без сомнения, будут играть все большую роль в нашем будущем, несмотря на существующие вызовы.